第 5 天:Silly Tavern 本地模型利用

现在我们在第 4 天 中学习了如何连接到云模型,让我们尝试使用本地模型。本地模型是在您自己的计算机上运行的人工智能。不需要互联网,完全免费,并且您的隐私受到完全保护。

在这篇文章中,我们将根据2026年的最新信息,以通俗易懂的方式为初学者讲解什么是本地模型、如何使用Ollama以及应该选择哪种模型。我们还将详细解释云模型之间的差异以及每种模型的优缺点。

在这个为期 7 天的系列的第 5 天,掌握利用本地模型并完全免费享受 Silly Tavern。

本地模型是什么? |在自己的PC上运行的AI

什么是本地模型是在您自己的计算机上运行而无需连接互联网的AI模型。例如,如果云模型是“从图书馆借书”,则本地模型就像“家里书架上的书”。

本地模型如何运作

使用本地模型,您下载一个文件(模型文件),该文件是人工智能的“大脑”,并在您自己的计算机上运行它。该文件的大小通常为几 GB 到几十 GB,并使用计算机内存 (RAM) 和 GPU 运行。

与云模型的差异

| 项目 | 本地模特 | 云模型 |

|---|---|---|

| 互联网 | 不需要 | 必填 |

| 费用 | 免费 | 很多都是收费的 |

| 隐私 | 全面保护 | 数据传出 |

| 性能 | 取决于电脑性能 | 始终高性能 |

| 设置 | 有点复杂 | 简单 |

| 硬件要求 | 高 | 低 |

> 💡 提示:我们建议初学者从云模型开始(参见第 4 天),然后在习惯后尝试本地模型。

本地模型的优缺点

在使用本地模型之前,请了解其优点和缺点。

好处

- 完全免费:一旦下载,无论使用多少次,都是免费的。

- 隐私保护:对话内容不对外传输

- 离线使用:无需网络,可以在任何地方使用

- 无限制:没有API使用限制或速率限制

- 可定制:您可以根据自己的喜好调整模型

缺点

- 硬件要求高:需要足够的内存和GPU

- 设置复杂:对于初学者来说可能很困难

- 性能取决于PC:在低规格PC上运行速度很慢

- 大模型尺寸:需要几GB到几十GB的存储空间

- 性能可能不如云:可能不如最新的云模型

Ollama 是什么?|最简单的本地模型执行工具

Ollama 是一个可以让您轻松运行本地模型的工具。比如,它就像一个“本地模特专属的应用商店”。您可以下载并运行您的模型,无需任何复杂的配置。

Ollama 的特点

- 安装简单:使用 Homebrew 一次性安装

- 轻松的模型管理:通过一个命令下载并运行

- Apple Silicon 优化:M1/M2/M3 芯片运行速度更快

- 自动内存管理:自动调整可用内存

- Silly Tavern 兼容:与标准 API 轻松连接

安装 Ollama | macOS 上的步骤

让我们安装 Ollama。如果您已经在第 2 天 安装了 Homebrew,那么这非常简单。

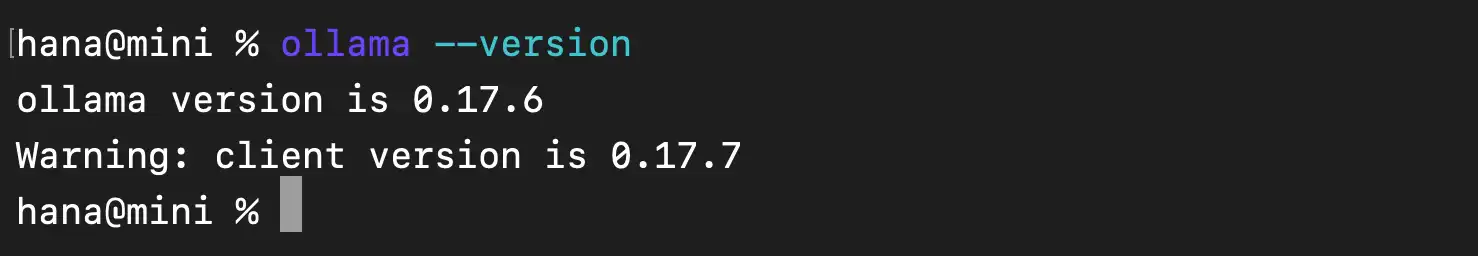

第 1 步:安装 Ollama

在终端中运行以下命令。

brew install ollama安装完成后,检查版本。

ollama --version如果显示版本号则说明成功。

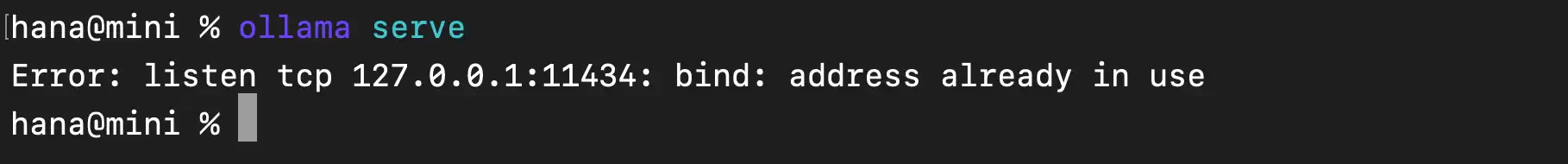

第2步:启动Ollama服务

在后台启动 Ollama。

ollama serve运行此命令后,Ollama 将在后台运行,并且 API 将在 http://localhost:11434 处可用。

> 💡 提示:保持此终端窗口打开。当您关闭它时,Ollama 将停止。

模型下载 |你应该选择哪一个?

Ollama 有多种型号可供选择。我们将推出截至 2026 年的推荐型号。

推荐型号列表

| 型号名称 | 尺寸 | 所需内存 | 性能 | 应用 |

|---|---|---|---|---|

| Qwen3.5 7B | 4.7GB | 4.7GB 8GB | 非常高 | 多语言/日语最强,适合初学者 |

| 米斯特拉尔小型 3.1 | 4.5GB | 4.5GB 8GB | 高 | 通用/快速响应,日常对话 |

| DeepSeek-R1 7B | 5.2GB | 10GB | 非常高 | 擅长推理/长文本/复杂任务 |

| Nemtron Mini 4B | 2.7GB | 2.7GB 6GB | 中等 | 适用于 NVIDIA 低规格 PC |

| Phi-4 迷你 3.8B | 2.5GB | 2.5GB 6GB | 中高 | 微软制造,轻量、高效 |

推荐给初学者

最推荐Qwen3.5 7B。原因是:

- 最好的日语支持

- 适用于 8GB 内存

- 多语言和高质量的回复

- OpenRouter排名第一的热门类

如何下载模型

打开一个新的终端窗口并运行以下命令。

ollama pull qwen3.5:7b下载将需要几分钟时间。完成后,模型即可使用。

Silly Tavern 和 Ollama 之间的连接

Ollama 准备好后,与 Silly Tavern 连接。

第 1 步:设置 Silly Tavern

- 启动Silly Tavern:访问

http://localhost:8000 - 打开API设置:从左上角菜单中选择“API连接”

- 选择“聊天完成”选项卡

- 选择API类型:选择“聊天完成”→“Ollama”

- 输入 URL:

http://localhost:11434(默认) - 选择模型:下载的模型(例如qwen3.5:7b)

- 点击“连接”

第2步:连接测试

选择一个角色并发送消息。如果得到回应,那就成功了!

> 💡 提示:第一次回复可能需要一些时间。因为模型已加载到内存中。

性能优化 |舒适使用的技巧

我们将介绍优化技术以方便地使用本地模型。

1.内存管理

问题:内存不足导致运行缓慢

解决方案:

- 选择较小的型号(例如 Nemotron Mini 4B)

- 关闭其他应用程序

- 在 Ollama 设置中调整最大内存

2. Apple Silicon 优化

配备 M1/M2/M3 芯片的 Mac 可以通过以下设置来加速。

# 启用Metal(GPU)(默认启用)

export OLLAMA_GPU_LAYERS=9993.模型量化

量化是一种减小模型大小的技术。例如,您可以通过量化为 8 位或 4 位来减少内存使用量。

在 Ollama 中,模型名称包含量化级别:

qwen3.5:7b- 标准qwen3.5:7b-q4_K_M- 4 位量化(较小)qwen3.5:7b-q8_0- 8 位量化(平衡)

其他本地模型工具

除了 Ollama 之外,还有其他工具可以让您运行本地模型。

LM工作室

LM Studio 是一个基于 GUI 的本地模型执行工具。它比 Ollama 更直观,更适合初学者。

- URL:https://lmstudio.ai/

- 特点:GUI操作、型号搜索功能、轻松设置

- Silly Tavern 连接:可与 OpenAI 兼容的 API 连接

狗头人人工智能

什么是KoboldAI是一个专门用于故事生成的本地模型工具。

- URL:https://github.com/KoboldAI/KoboldAI-Client

- 特点:故事生成,冒险模式

- Silly Tavern 连接:使用专用 API 连接

Oobabooga 文本生成 WebUI

Oobabooga 是一个高度可定制的本地建模工具。

- URL:[https://github.com/oobabooga/text- Generation-webui](https://github.com/oobabooga/text- Generation-webui)

- 功能:丰富的设置和扩展

- Silly Tavern 连接:与 OpenAI 兼容的 API 连接

云与本地 |你应该选择哪个?

我应该使用云模型还是本地模型?

推荐云模型的人群

- 寻求高性能:想要使用最新的高性能AI

- 低规格电脑:内存和 GPU 较低

- 我想轻松开始:我想避免复杂的设置

- 可以支付费用:每月可以支付几美元到几十美元。

推荐本地模特的人

- 注重隐私:我不想将对话内容发送给外部各方。

- 我想完全免费使用它:我不想花任何钱

- 离线使用:没有互联网连接的环境

- 高规格PC:有足够的内存和GPU

混合使用

许多用户同时使用:

- 重要对话:本地模型(隐私保护)

- 高质量要求:云模型(性能导向)

- 日常对话:本地模型(免费)

- 复杂任务:云模型(高性能)

常见问题及解决方法

我们将介绍使用本地模型时出现的常见问题以及如何解决这些问题。

问题 1:内存不足错误

原因:模型太大或其他应用程序正在使用内存

解决方案:

- 更改为更小的型号

- 关闭其他应用程序

- 使用量化模型

问题2:响应速度非常慢

原因:CPU/GPU性能不足

解决方案:

- 使用较小的模型

- 在 Apple Silicon 上启用 Metal (GPU)

- 停止后台进程

问题 3:无法连接到 Ollama

原因:Ollama 服务未启动

解决方案:

- 在终端中运行“ollamaserve”

- 检查端口11434是否可用

问题 4:找不到模型

原因:模型未下载

解决方案:

- 在“ollama list”上检查下载的模型

- 使用

ollama pull <模型名称>重新下载

下一步 |高级定制

您已经掌握了本地模型的基础知识!接下来我们来学习更多高级定制。

接下来您将学到什么:

- 第 6 天:高级定制 - 提示工程和 UI 设置

- 第 7 天:如何使用智能手机 - 开始使用 MiniTavern 的简单方法

对于那些想要更轻松开始的人: 如果您发现建立本地模型有困难,请尝试MiniTavern。您可以使用云模型享受简单的人工智能聊天。有关详细信息,请参阅第 7 天。

总结

感谢您的辛勤工作!在这篇文章中,我们根据2026年的最新信息解释了如何在Silly Tavern中使用本地模型。内容从安装Ollama、选择模型、连接到Silly Tavern到优化性能,即使对于初学者来说也很容易理解。

通过本地模式,您可以完全免费且私密地享受 Silly Tavern。下一步是学习高级定制,并更深入地了解 Silly Tavern!

参考链接

关于作者

常见问题(FAQ)

Q1:本地模型是完全免费的吗?

是的,它是完全免费的。下载模型后,您可以根据需要多次使用它,而无需任何额外费用。

Q2:我需要多少内存?

最低 8GB,建议 16GB 或以上。较小的型号(Phi-3 Mini)可使用 4GB。

Q3:它可以与 M1/M2/M3 芯片一起使用吗?

是的,它针对 Apple Silicon 进行了优化,并且运行速度很快。

Q4:性能比云模型差吗?

虽然整体表现较差,但对于日常会话水平来说已经足够了。它具有隐私和免费的优点。

Q5:可以离线使用吗?

是的,一旦您下载了模型,就可以完全离线使用。

Q6:您推荐哪种型号?

初学者推荐 Qwen3.5 7B。中文支持出色,可在 8GB 内存上运行。

Q7:需要 GPU 吗?

虽然不是必需的,但拥有 GPU 会显著加快速度。Apple Silicon Mac 配备集成 GPU,速度更快。

Q8:我可以同时使用多个型号吗?

如果您有足够的内存,这是可能的,但通常您一次只使用一个。

Q9:支持中文吗?

是的,Qwen3.5 和 Mistral Small 3.1 等对中文有良好支持。

Q10:可以在 Windows 上使用吗?

是的,Ollama 与 Windows、macOS 和 Linux 兼容。

撰写日期:2026年3月14日

最后更新: 2026年3月27日