第 5 天:Silly Tavern 本地模型利用

現在我們在第 4 天 中學習瞭如何連接到雲模型,讓我們嘗試使用本地模型。本地模型是在您自己的計算機上運行的人工智能。不需要互聯網,完全免費,並且您的隱私受到完全保護。

在這篇文章中,我們將根據2026年的最新信息,以通俗易懂的方式為初學者講解什麼是本地模型、如何使用Ollama以及應該選擇哪種模型。我們還將詳細解釋雲模型之間的差異以及每種模型的優缺點。

在這個為期 7 天的系列的第 5 天,掌握利用本地模型並完全免費享受 Silly Tavern。

本地模型是什麼? |在自己的PC上運行的AI

什麼是本地模型是在您自己的計算機上運行而無需連接互聯網的AI模型。例如,如果雲模型是“從圖書館借書”,則本地模型就像“家裡書架上的書”。

本地模型如何運作

使用本地模型,您下載一個文件(模型文件),該文件是人工智能的“大腦”,並在您自己的計算機上運行它。該文件的大小通常為幾 GB 到幾十 GB,並使用計算機內存 (RAM) 和 GPU 運行。

與雲模型的差異

| 項目 | 本地模特 | 雲模型 |

|---|---|---|

| 互聯網 | 不需要 | 必填 |

| 費用 | 免費 | 很多都是收費的 |

| 隱私 | 全面保護 | 數據傳出 |

| 性能 | 取決於電腦性能 | 始終高性能 |

| 設置 | 有點複雜 | 簡單 |

| 硬件要求 | 高 | 低 |

> 💡 提示:我們建議初學者從雲模型開始(參見第 4 天),然後在習慣後嘗試本地模型。

本地模型的優缺點

在使用本地模型之前,請了解其優點和缺點。

好處

- 完全免費:一旦下載,無論使用多少次,都是免費的。

- 隱私保護:對話內容不對外傳輸

- 離線使用:無需網絡,可以在任何地方使用

- 無限制:沒有API使用限制或速率限制

- 可定製:您可以根據自己的喜好調整模型

缺點

- 硬件要求高:需要足夠的內存和GPU

- 設置複雜:對於初學者來說可能很困難

- 性能取決於PC:在低規格PC上運行速度很慢

- 大模型尺寸:需要幾GB到幾十GB的存儲空間

- 性能可能不如雲:可能不如最新的雲模型

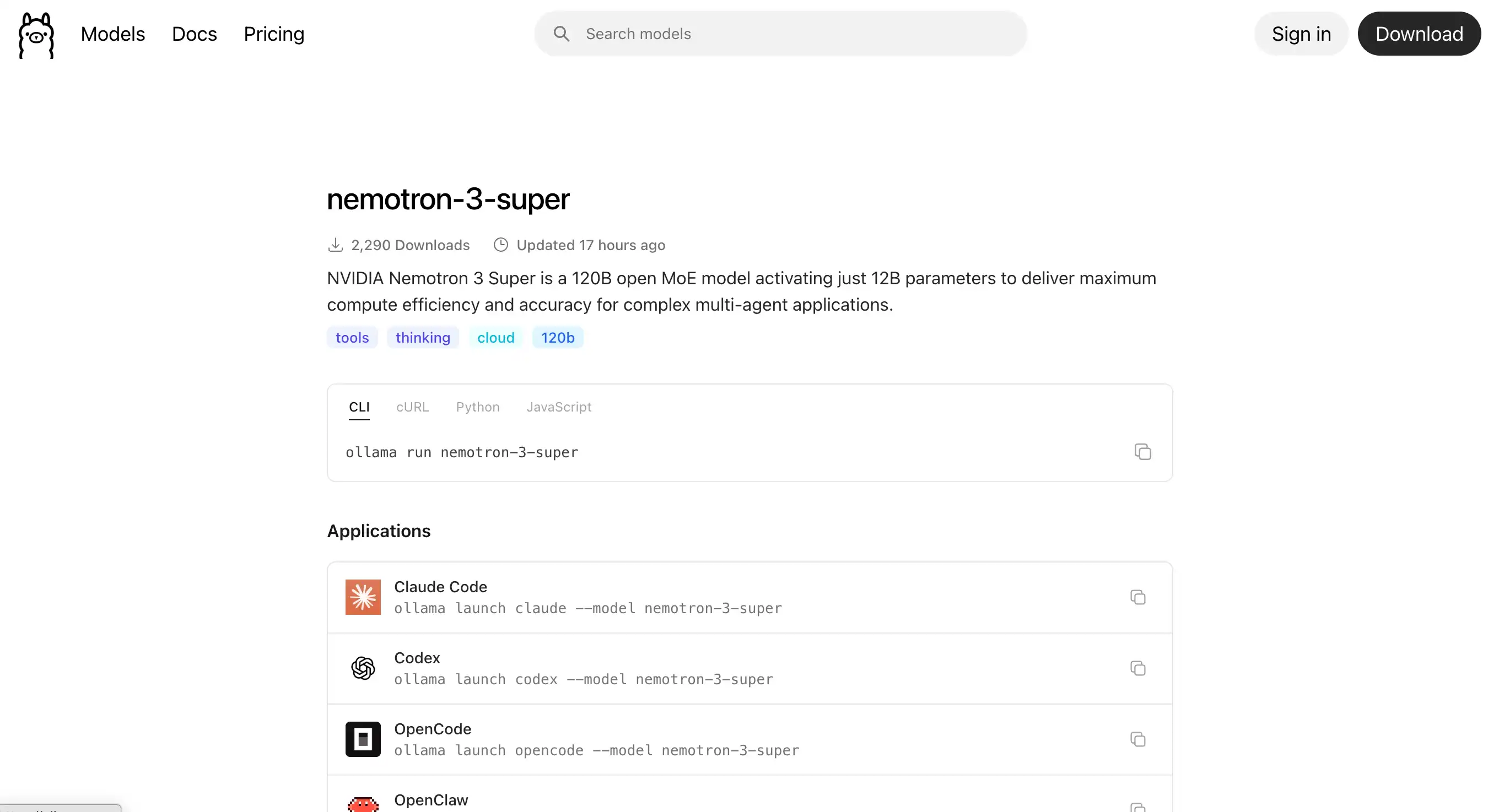

Ollama 是什麼?|最簡單的本地模型執行工具

Ollama 是一個可以讓您輕鬆運行本地模型的工具。比如,它就像一個“本地模特專屬的應用商店”。您可以下載並運行您的模型,無需任何複雜的配置。

Ollama 的特點

- 安裝簡單:使用 Homebrew 一次性安裝

- 輕鬆的模型管理:通過一個命令下載並運行

- Apple Silicon 優化:M1/M2/M3 芯片運行速度更快

- 自動內存管理:自動調整可用內存

- Silly Tavern 兼容:與標準 API 輕鬆連接

安裝 Ollama | macOS 上的步驟

讓我們安裝 Ollama。如果您已經在第 2 天 安裝了 Homebrew,那麼這非常簡單。

第 1 步:安裝 Ollama

在終端中運行以下命令。

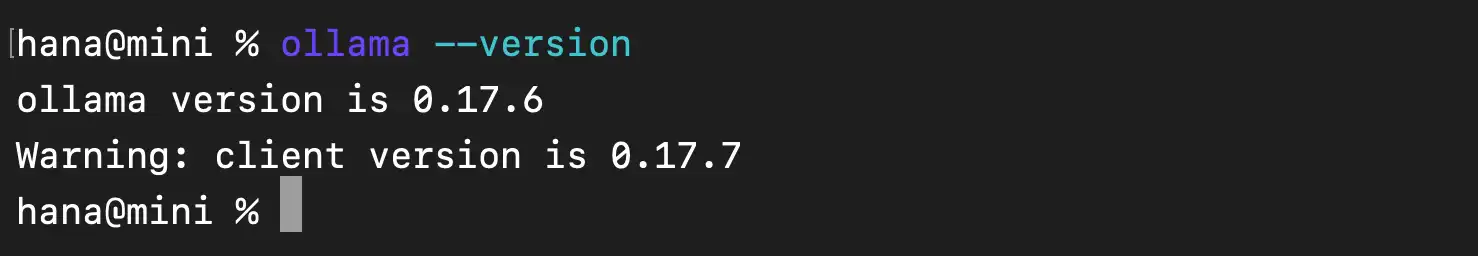

brew install ollama安裝完成後,檢查版本。

ollama --version如果顯示版本號則說明成功。

第2步:啟動Ollama服務

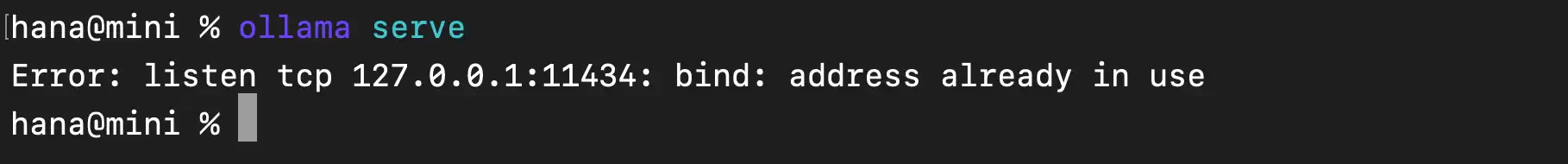

在後臺啟動 Ollama。

ollama serve運行此命令後,Ollama 將在後臺運行,並且 API 將在 http://localhost:11434 處可用。

> 💡 提示:保持此終端窗口打開。當您關閉它時,Ollama 將停止。

模型下載 |你應該選擇哪一個?

Ollama 有多種型號可供選擇。我們將推出截至 2026 年的推薦型號。

推薦型號列表

| 型號名稱 | 尺寸 | 所需內存 | 性能 | 應用 |

|---|---|---|---|---|

| Qwen3.5 7B | 4.7GB | 4.7GB 8GB | 非常高 | 多語言/日語最強,適合初學者 |

| 米斯特拉爾小型 3.1 | 4.5GB | 4.5GB 8GB | 高 | 通用/快速響應,日常對話 |

| DeepSeek-R1 7B | 5.2GB | 10GB | 非常高 | 擅長推理/長文本/複雜任務 |

| Nemtron Mini 4B | 2.7GB | 2.7GB 6GB | 中等 | 適用於 NVIDIA 低規格 PC |

| Phi-4 迷你 3.8B | 2.5GB | 2.5GB 6GB | 中高 | 微軟製造,輕量、高效 |

推薦給初學者

最推薦Qwen3.5 7B。原因是:

- 最好的日語支持

- 適用於 8GB 內存

- 多語言和高質量的回覆

- OpenRouter排名第一的熱門類

如何下載模型

打開一個新的終端窗口並運行以下命令。

ollama pull qwen3.5:7b下載將需要幾分鐘時間。完成後,模型即可使用。

Silly Tavern 和 Ollama 之間的連接

Ollama 準備好後,與 Silly Tavern 連接。

第 1 步:設置 Silly Tavern

- 啟動Silly Tavern:訪問

http://localhost:8000 - 打開API設置:從左上角菜單中選擇“API連接”

- 選擇“聊天完成”選項卡

- 選擇API類型:選擇“聊天完成”→“Ollama”

- 輸入 URL:

http://localhost:11434(默認) - 選擇模型:下載的模型(例如qwen3.5:7b)

- 點擊“連接”

第2步:連接測試

選擇一個角色併發送消息。如果得到回應,那就成功了!

> 💡 提示:第一次回覆可能需要一些時間。因為模型已加載到內存中。

性能優化 |舒適使用的技巧

我們將介紹優化技術以方便地使用本地模型。

1.內存管理

問題:內存不足導致運行緩慢

解決方案:

- 選擇較小的型號(例如 Nemotron Mini 4B)

- 關閉其他應用程序

- 在 Ollama 設置中調整最大內存

2. Apple Silicon 優化

配備 M1/M2/M3 芯片的 Mac 可以通過以下設置來加速。

# 啟用Metal(GPU)(默認啟用)

export OLLAMA_GPU_LAYERS=9993.模型量化

量化是一種減小模型大小的技術。例如,您可以通過量化為 8 位或 4 位來減少內存使用量。

在 Ollama 中,模型名稱包含量化級別:

qwen3.5:7b- 標準qwen3.5:7b-q4_K_M- 4 位量化(較小)qwen3.5:7b-q8_0- 8 位量化(平衡)

其他本地模型工具

除了 Ollama 之外,還有其他工具可以讓您運行本地模型。

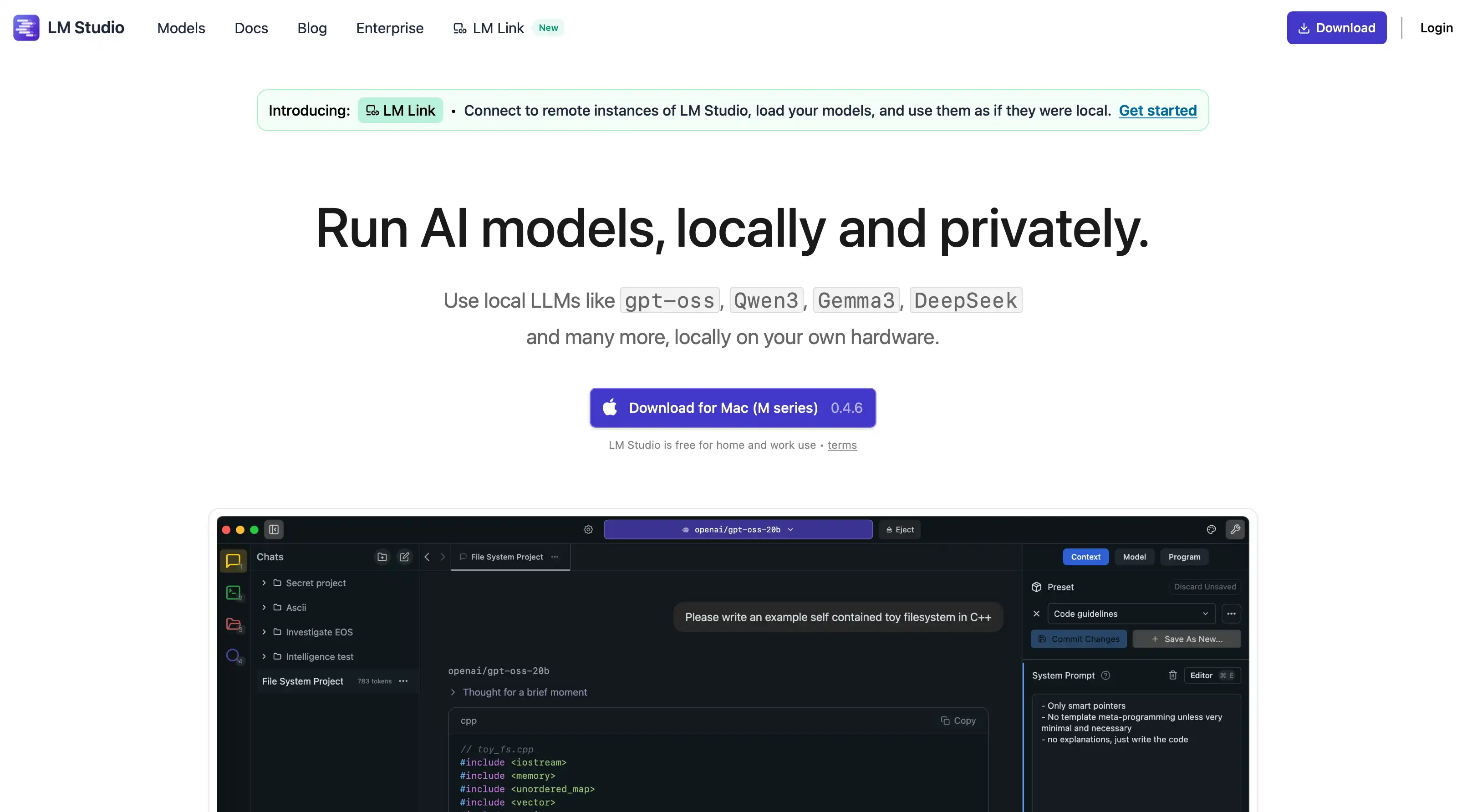

LM工作室

LM Studio 是一個基於 GUI 的本地模型執行工具。它比 Ollama 更直觀,更適合初學者。

- URL:https://lmstudio.ai/

- 特點:GUI操作、型號搜索功能、輕鬆設置

- Silly Tavern 連接:可與 OpenAI 兼容的 API 連接

狗頭人人工智能

什麼是KoboldAI是一個專門用於故事生成的本地模型工具。

- URL:https://github.com/KoboldAI/KoboldAI-Client

- 特點:故事生成,冒險模式

- Silly Tavern 連接:使用專用 API 連接

Oobabooga 文本生成 WebUI

Oobabooga 是一個高度可定製的本地建模工具。

- URL:[https://github.com/oobabooga/text- Generation-webui](https://github.com/oobabooga/text- Generation-webui)

- 功能:豐富的設置和擴展

- Silly Tavern 連接:與 OpenAI 兼容的 API 連接

雲與本地 |你應該選擇哪個?

我應該使用雲模型還是本地模型?

推薦雲模型的人群

- 尋求高性能:想要使用最新的高性能AI

- 低規格電腦:內存和 GPU 較低

- 我想輕鬆開始:我想避免複雜的設置

- 可以支付費用:每月可以支付幾美元到幾十美元。

推薦本地模特的人

- 注重隱私:我不想將對話內容發送給外部各方。

- 我想完全免費使用它:我不想花任何錢

- 離線使用:沒有互聯網連接的環境

- 高規格PC:有足夠的內存和GPU

混合使用

許多用戶同時使用:

- 重要對話:本地模型(隱私保護)

- 高質量要求:雲模型(性能導向)

- 日常對話:本地模型(免費)

- 複雜任務:雲模型(高性能)

常見問題及解決方法

我們將介紹使用本地模型時出現的常見問題以及如何解決這些問題。

問題 1:內存不足錯誤

原因:模型太大或其他應用程序正在使用內存

解決方案:

- 更改為更小的型號

- 關閉其他應用程序

- 使用量化模型

問題2:響應速度非常慢

原因:CPU/GPU性能不足

解決方案:

- 使用較小的模型

- 在 Apple Silicon 上啟用 Metal (GPU)

- 停止後臺進程

問題 3:無法連接到 Ollama

原因:Ollama 服務未啟動

解決方案:

- 在終端中運行“ollamaserve”

- 檢查端口11434是否可用

問題 4:找不到模型

原因:模型未下載

解決方案:

- 在“ollama list”上檢查下載的模型

- 使用

ollama pull <模型名稱>重新下載

下一步 |高級定製

您已經掌握了本地模型的基礎知識!接下來我們來學習更多高級定製。

接下來您將學到什麼:

- 第 6 天:高級定製 - 提示工程和 UI 設置

- 第 7 天:如何使用智能手機 - 開始使用 MiniTavern 的簡單方法

對於那些想要更輕鬆開始的人: 如果您發現建立本地模型有困難,請嘗試MiniTavern。您可以使用雲模型享受簡單的人工智能聊天。有關詳細信息,請參閱第 7 天。

總結

感謝您的辛勤工作!在這篇文章中,我們根據2026年的最新信息解釋了如何在Silly Tavern中使用本地模型。內容從安裝Ollama、選擇模型、連接到Silly Tavern到優化性能,即使對於初學者來說也很容易理解。

通過本地模式,您可以完全免費且私密地享受 Silly Tavern。下一步是學習高級定製,並更深入地瞭解 Silly Tavern!

參考鏈接

關於作者

常見問題(FAQ)

Q1:本地模型是完全免費的嗎?

是的,它是完全免費的。下載模型後,您可以根據需要多次使用它,而無需任何額外費用。

Q2:我需要多少內存?

最低 8GB,建議 16GB 或以上。較小的型號(Phi-3 Mini)可使用 4GB。

Q3:它可以與 M1/M2/M3 芯片一起使用嗎?

是的,它針對 Apple Silicon 進行了優化,並且運行速度很快。

Q4:性能比雲模型差嗎?

雖然整體表現較差,但對於日常會話水平來說已經足夠了。它具有隱私和免費的優點。

Q5:可以離線使用嗎?

是的,一旦您下載了模型,就可以完全離線使用。

Q6:您推薦哪種型號?

初學者推薦 Qwen3.5 7B。中文支持出色,可在 8GB 內存上運行。

Q7:需要 GPU 嗎?

雖然不是必需的,但擁有 GPU 會顯著加快速度。Apple Silicon Mac 配備集成 GPU,速度更快。

Q8:我可以同時使用多個型號嗎?

如果您有足夠的內存,這是可能的,但通常您一次只使用一個。

Q9:支持中文嗎?

是的,Qwen3.5 和 Mistral Small 3.1 等對中文有良好支持。

Q10:可以在 Windows 上使用嗎?

是的,Ollama 與 Windows、macOS 和 Linux 兼容。

撰寫日期:2026年3月14日

最後更新: 2026年3月27日